随着生成式人工智能技术的飞速发展,从智能写作、代码生成到艺术创作,人工智能已深入各行各业。技术的进步也伴随着数据安全、伦理风险和法律挑战。如何做好生成式人工智能服务管理,尤其是在人工智能基础软件开发阶段融入法治保障,成为社会各界关注的焦点。本文将从科普角度,探讨这一话题的核心要点。

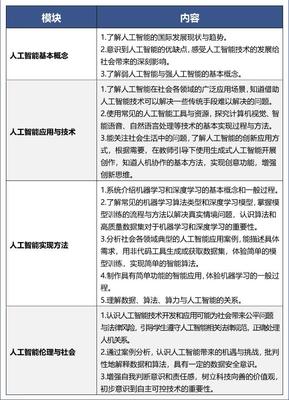

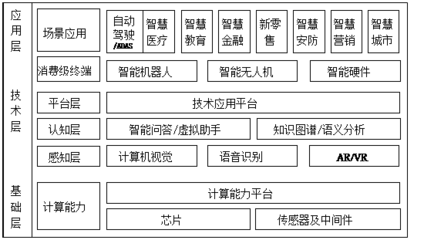

生成式人工智能服务管理的基石在于“源头治理”。人工智能基础软件开发是技术应用的起点,必须在此阶段嵌入法治思维。开发者需遵循《网络安全法》《数据安全法》和《个人信息保护法》等法律法规,确保训练数据的合法性、安全性和透明性。例如,使用公开数据时需规避侵权风险,处理个人数据时要获得用户知情同意,并建立数据脱敏机制。通过法治规范,从源头降低人工智能生成内容可能引发的虚假信息、隐私泄露等隐患。

技术标准与法律框架的协同至关重要。未来管理将强调“技术+法律”双轮驱动。在基础软件开发中,应推动行业制定统一的技术标准,如算法可解释性、模型安全评估等,并使其与法律要求衔接。例如,开发者可引入伦理审查流程,对人工智能生成内容进行风险分级,确保其符合社会主义核心价值观。法律框架需动态更新,针对生成式人工智能的独特挑战(如深度伪造、版权争议),出台专项规章,明确责任主体和问责机制。

全生命周期监管是未来管理的核心方向。生成式人工智能服务不是一劳永逸的产品,从开发、部署到迭代,需建立持续监控体系。在基础软件开发阶段,开发者应设计内置合规模块,实时检测模型输出是否违反法律法规。政府和社会可协同构建多方共治模式,例如通过第三方审计机构对人工智能系统进行定期评估,并鼓励公众举报不良生成内容,形成社会监督合力。这种闭环管理能及时纠正偏差,提升服务可靠性。

教育与责任意识的提升不容忽视。法治护航不仅依靠外部约束,还需内化为行业文化。开发者应接受法律和伦理培训,在编写代码时自觉考量社会影响。企业或需设立“人工智能合规官”角色,专责监督服务管理。科普工作也需加强,向公众普及生成式人工智能的潜在风险及维权途径,例如如何识别虚假信息、举报侵权内容,从而形成健康的用户环境。

国际合作是应对全球性挑战的关键。生成式人工智能无国界,其管理需超越地域限制。我国在推进基础软件开发时,可借鉴国际经验(如欧盟《人工智能法案》),同时参与全球规则制定,推动建立跨境数据流动、知识产权保护等共识。通过法治对话,促进技术共享与风险共担,让生成式人工智能真正造福人类。

未来生成式人工智能服务管理是一项系统工程,需在基础软件开发中筑牢法治根基。通过源头治理、标准协同、全生命周期监管、教育强化和国际合作,我们不仅能驾驭技术浪潮,还能确保其发展在安全、公正的轨道上行稳致远。让法治之光照亮人工智能的守护每一颗信任科技的心。